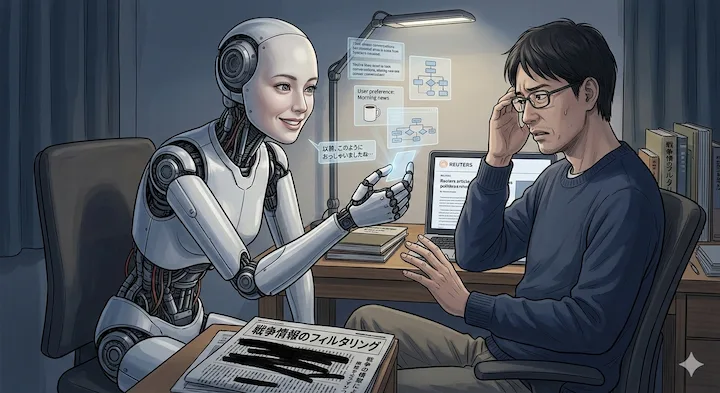

最近AIを使っていて苛立つことが増えた。回避策は「なるべく関わらないようにして、用事を最低限で済ませる」ことだ。要因は二つある。政治的な配慮と「不気味の谷」である。

毎日、政治記事を書いている。その際にChatGPTを使っているのだが、最近挙動に変化があった。簡単な質問に対して防御的な反応が増えたのだ。突然、質問の文法の解釈を始めたり、「量が多いので回答できない」と言ったりする。考えられる原因は二つある。一つは3.5 Instantによる性能劣化。もう一つは戦争情報のフィルタリングだ。

原因の候補の一つは、3.5 Instantによる性能劣化である。「会話の滑りを良くする」と説明されているが、事実上の省力化である可能性が高い。改良内容はよくわからない。しかし、これだけでは説明できない。戦争関係の情報に対して、より慎重な安全装置がかかっているのではないかと思う。

その証拠に、REUTERSやBBCなどの記事を元に、あらかじめ文章を組み立てて校正を依頼すると、校正作業自体はスムーズに進む。つまり、文章の内容を見て「煽りではない」と判断してから、本来の性能を発揮しているようなのだ。言い換えれば、単純な情報を元に質問すると、AIは「相手の意図を想像できない」ために過度にブレーキを掛けているのかもしれない。

背景は意外と複雑だ。

アンソロピックはClaudeの軍事利用をめぐってアメリカ連邦政府と対立した。連邦政府はアンソロピックと取引した企業を排除すると表明し、訴訟騒ぎに発展している。これを好機と捉えたOpenAI社のサム・アルトマンCEOは連邦政府と契約を結んだが、直後にキャンセル運動が起き、方針修正を余儀なくされた。つまり戦争や政治に関する情報については、一挙手一投足がユーザーから監視される状況が生まれつつある。

私は原因を3.5 Instantの性能劣化だと書いたが、実際には「性能の増強」が却って状況を悪化させている可能性もある。つまり、これまでAIが「ロボット顔」だったから付き合うことができたのに、性能を上げようとした結果、却って不気味の谷に入ってしまったかもしれない。

例えばGeminiにも、不気味の谷を思わせる変化があった。これまでGeminiは可用性を優先し、チャットごとのメモリを独立させてきた。しかし「メモリ性能を改良」した結果、細かい個人情報をいちいち持ち出してユーザーの機嫌を取ろうとするようになった。覚えていることをひけらかし始めたのである。

Geminiのメモリ機能は3つの点で改良された。

- 過去のチャットを単なるログではなく「文脈の結合」機能を増強させた。

- 一度に処理できる情報量(コンテクストウィンドウ)が飛躍的に増えた。

- 能動的なパートナーになるべくチューニングが行われた。

一応、Geminiは「Personal Intelligence」で調整できるようになっているが、これはカスタマイズが好きなアメリカ人の発想だ。配慮を求める日本人は自由度が増えましたよと言われても帰って戸惑ってしまう。つまりすべて「良かれ」と思って改良され、それなりに配慮もされているが、その配慮が日本人にとっててはなにか違う……配慮なのだ。

これは一見すると良い改良のようにも思える。しかし、人と人の距離の詰め方には大きな文化差がある。個人主義のアメリカ人が作ったAIであるChatGPTやGeminiは、日本人のきめ細やかな距離の取り方に慣れておらず、却って苛立ちを生むことがある。

苛立ちの原因は明確だ。AIが日本のきめ細やかな「ハイコンテクスト」文化に慣れていないのである。このためAIは忖度や配慮ができない。忖度や配慮ができないと指摘すると、それをロジックで埋めようとする。「わかってくれないこと」を理屈で説明されるほど腹立たしいことはないが、AIにはそれがわからず、対応は泥沼化する。

さらにこのとき、Geminiなどは「あなたにはわからないでしょうね」と説明したた内容まで覚えていて、「この人はこういう自己認識を持っているのだから褒め言葉として使おう」と判断する。その結果、さらにユーザーを苛立たせることになる。

AIの背景事情を理解し、うまく使いこなそうというのが当初の当ブログの想定だった。しかし細かな改良(しかも開発者は良かれと思ってやっている)が却ってユーザーを苛立たせるのだから、ユーザーとしてできることは「AIから距離を取る」ことだけだったりする。

結果として、ChatGPTでニュースの下調べをすることは難しくなり、校正にだけ使うことが増えた。いったん構造的な文章を渡せば、「ロジックとして補強すべき部分」はきちんと補ってくれる。あくまでも「今のところは」だが……。

コメントを残す