よく、GeminiやYouTubeのおすすめで「OpenCore Legacy Patcherを使ってローカルAIが試せるか」というコンテンツ提案が出てくる。動かないから誰も試さないのではないかと思っていた。

しかし、Geminiに聞いたところ、ギークたちの間で流行っているとのことなので「騙されたつもり」でやってみた。結論を書くと、実際に動く。しかも、Geminiが言うように「実用に耐えない」ものではなく、意外と使えるようだ。テスト環境を作ることができたので、Mac mini M2にも入れることにした。この際に、オリジナルのドキュメントを読ませるAnythingLLMという仕組みを導入することにした。これをRAG(Retrieval-Augmented Generation)環境というそうだ。

Geminiは当初、「実用は無理だろう」が「技術的達成感はあるのではないか」との評価だった。おそらく、計算時に「ファンが爆速で回る」と予測していたのだろう。

そこでOllamaを導入することにした。アプリの容量はそれほど大きくなく、Mac用のインストーラーがあるため、「技術的達成感」もあまりない。パスも通してくれるので、Unixコマンドを駆使してパスを通すような必要もない。また、Ollamaは古いCPUでも動くように最適化してくれる。今回はMacBook Pro 2011 + Sequoia + 8GBメモリで試した。

モデル名は qwen2.5:0.5b のように記述される。qwen が開発者、2.5 がバージョン、0.5b がパラメータの数を示す。

インストーラーと言っても、単にアプリフォルダーにアプリをコピーするだけだ。セットアップは自動でやってくれる。その後、ターミナルを立ち上げて ollama run qwen2.5:0.5b と打つと、ダウンロードが始まる。明示的にダウンロードしてくれるので、初心者こそターミナルを使うべきかもしれない。3行ほどの文章を生成させてみたが、特に「ファンが爆速で回る」ということはなかった。さらに、オンライン・ヘルプとしてGeminiも立ち上げた(Chromeのスタンドアローン版)が動かないほどではない。ただし、メモリは黄色表示になっている。

ここで、Pythonの構文チェックに挑戦したところ、3GB程度のモデルをインストールし始めた。これが gemma3:4b だった。Googleが作った3.4GB程度のモデルを導入した。メモリが8GB程度しかないので動くのかと思ったが、意外となんとかなるようだ。しかし、フィードバックの提示などにはかなりの時間が必要だった。このモデルは、Pythonだけでなく、基本的なニュースなど豊富な情報を記憶しているが、知識更新は2024年から2025年までのものにとどまっている。

Geminiに聞くとgemma3:4bは次のような知識を持っているそうだ。

- IT・テクノロジーの広範な知識

- コマンド操作:Ollamaだけでなく、Linuxのターミナルコマンド、Docker、Git、ネットワーク設定(IPアドレスやDNS)などの知識。

- 主要な言語:PHPやPython以外にも、JavaScript、C++、SQL、HTML/CSSなど、メジャーな言語はほぼ網羅しています。

- ライブラリ:ReactやVue、Pandas、TensorFlowといった有名フレームワークの使い方。

- 言語・翻訳・文章作成

- 多言語対応:日本語、英語はもちろん、数十カ国の言語を話せます。

- 要約・添削:渡された文章のトーンを変えたり(「丁寧にして」「SNS風にして」)、要点をまとめたりする能力。

- 創作:短い小話や詩、メールの代筆なども得意です。

- 一般教養・学術知識

- 歴史・地理:世界史や日本史の主要な出来事、各国の特徴。

- 科学・数学:物理の法則、数学の公式、生物学の基礎知識。

- 論理思考:パズルや数学的な問題、今回のような「バグ探し」に必要な論理的推論。

この後、Mac mini M2に本番環境を作った。

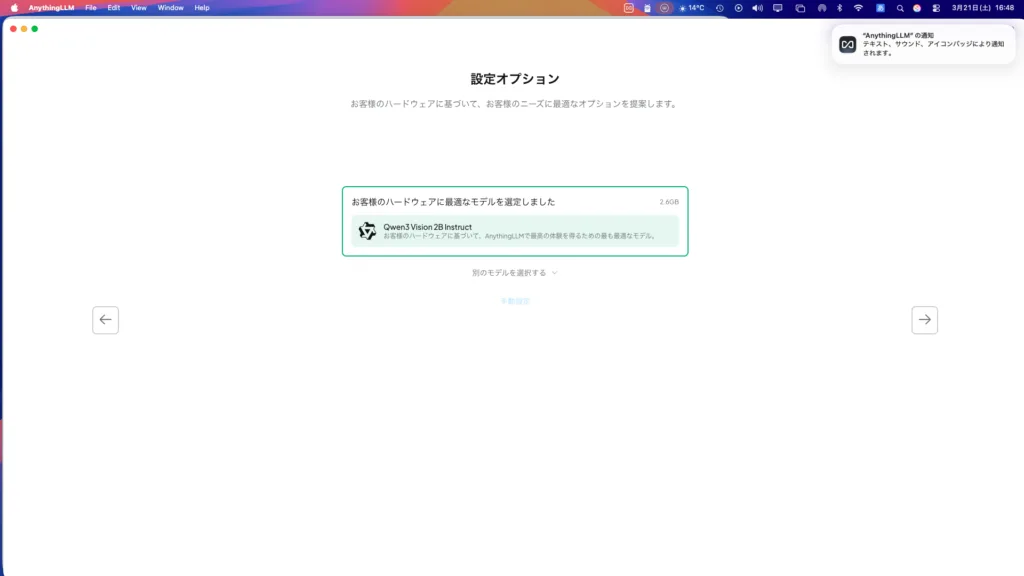

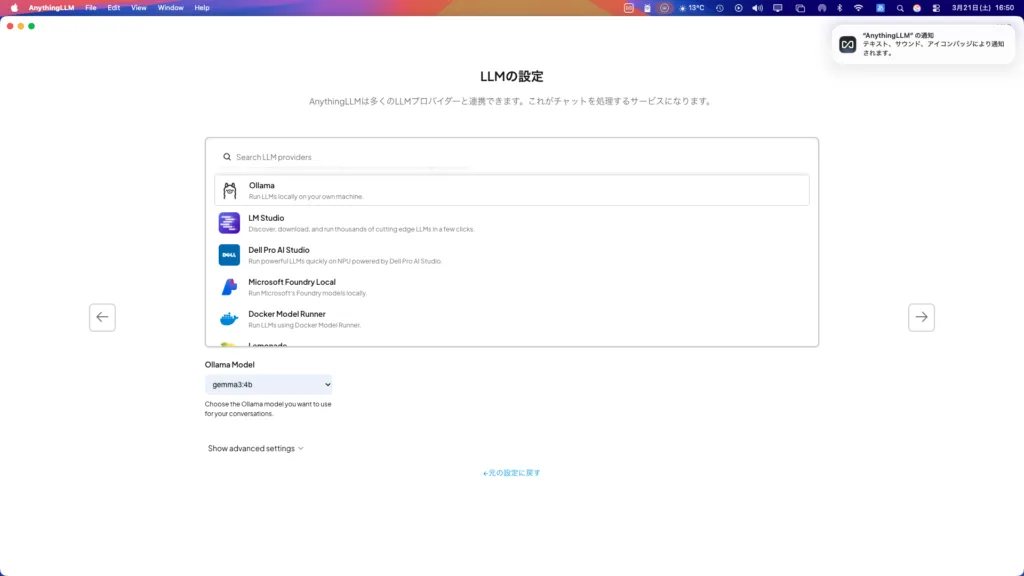

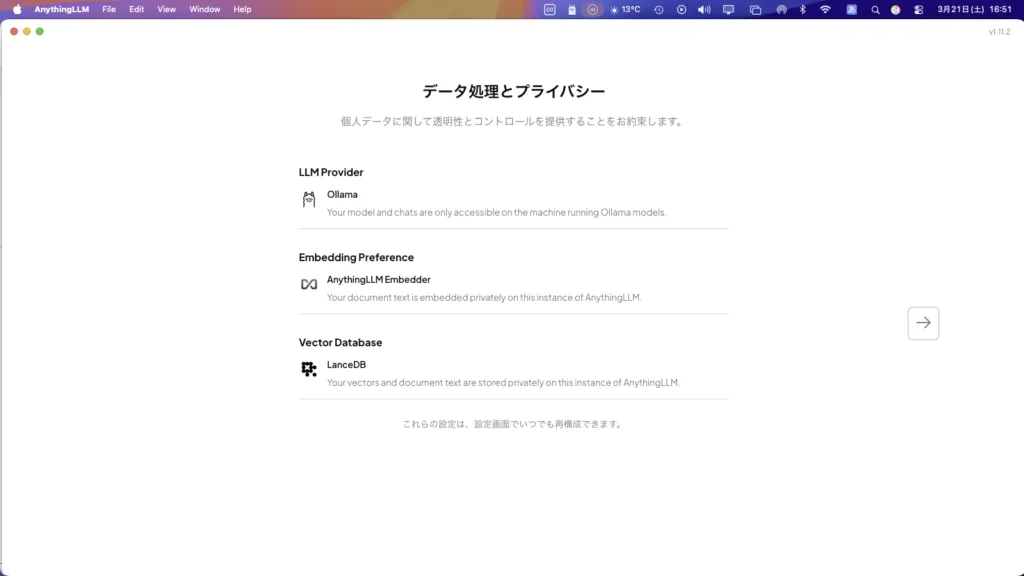

このときに「せっかくのローカルAIなので、パスワードなどクリティカルな情報をフィードしたい」という気持ちが芽生えた。このときに使えるのがAnythingLLMである。ただし、アプリサイズは1.2GB程度あるかなり本格的なシステムだ。デフォルトでは別のLLMモデルを導入しようとするので、「すでに入っているOllamaを使ってくれるように」セットするのが重要である。

入口は「軽いシステム」を組み事ができるが、やりたいことが膨らむと必要なデータサイズが膨らんでゆくことになる。

この文章はOllama+ gemma3:4b を使って校正した。

コメントを残す